개요

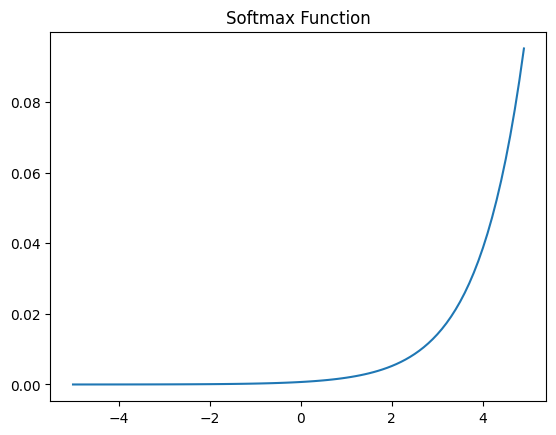

Softmax Function

개요

k차원의 벡터, i번째 원소를 , i번째 클래스가 정답일 확률

출력

0과 1사이의 실수.

원본 링크

각 원소의 총합은 1이다.

예시

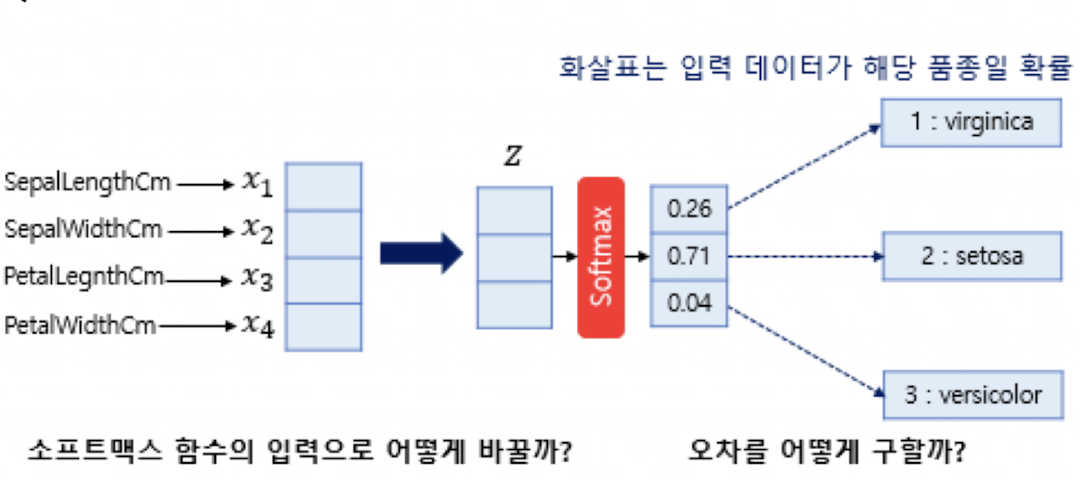

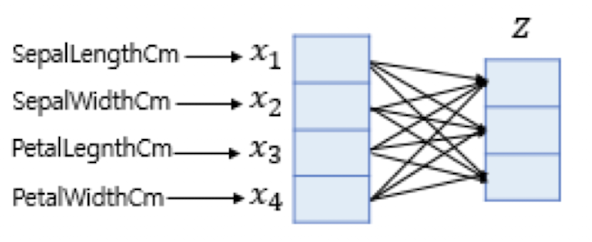

소프트맥스 함수의 입력

하나의 샘플 데이터의 독립 변수 4차원 벡터, 소프트맥스 함수는 3차원 벡터를 입력으로 받음.

각각의 화살표는 각각의 가중치. 총 12개. 학습 과정에서 변함.

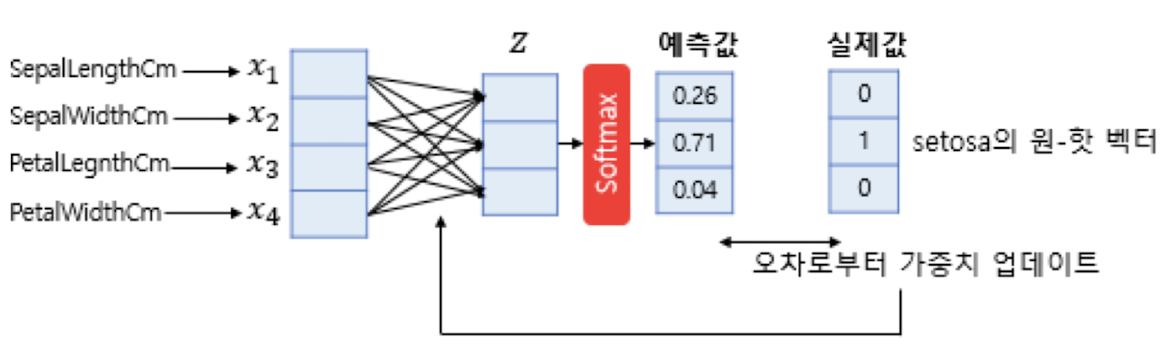

오차를 구하는 방법

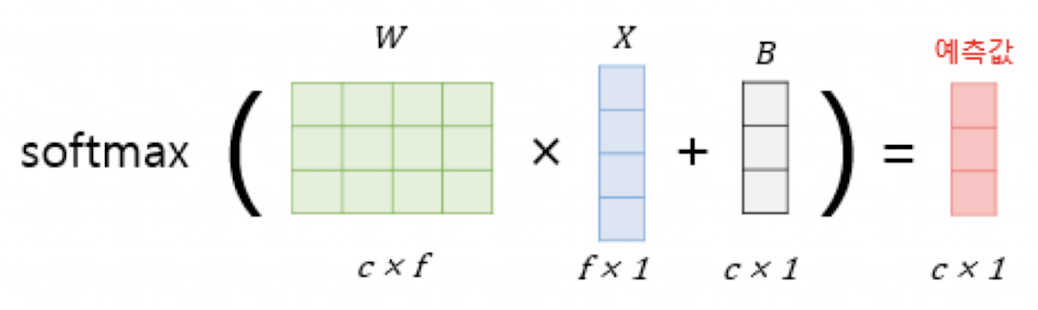

소프트맥스 회귀에서 예측값을 구하는 과정을 행렬으로 표현

Cost Function of Softmax Regression

Cross Entropy Function

개요

: 분류해야 하는 전체 클래스의 개수

: 입력 특징의 개수

: 클래스 인덱스

: 정답을 벡터로 표현한 것의 j번째 값(보통 One-Hot Vector

예를 들어, 클래스가 3개이고 정답이 두 번째 클래스라면

따라서

-

-

-

: 모델이 예측한 클래스 j일 확률. 보통 Softmax로 계산된다.

출력값 : 스칼라정답 클래스 확률이 높을수록 loss가 작아지고 정답 클래스 확률이 낮으면 loss가 커지도록 설계되었다.

가 One-Hot Vector라면

결국 식은 으로 정답일 확률에 로그를 씌운것에 불과하다.

정답일 확률이 1이면 손실함수는 0, 정답 확률이 0.1이면 2.3n개 데이터 전체에 대한 평균

복잡하네. 간단히 예시 넣어보기이진 분류에서의 크로스 엔트로피 함수

Cross Entropy Function Subtitution Example에서 확인할 수 있듯이, 동일한 식이다.

원본 링크